如何解决TensorFlow进行非线性回归时回归函数值域异常?

0

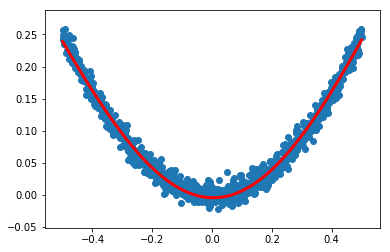

在进行非线性回归时,许多教程以 y=x^2 为例,比如这篇文章:Tensorflow实现回归(例子)

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

#制造数据,加上随机噪声

x_data = np.linspace(-0.5, 0.5, 200)[:,np.newaxis]

noise = np.random.normal(0, 0.02, x_data.shape)

y_data=np.square(x_data)+noise

#定义两层简单的网络

x=tf.placeholder(tf.float32,[None,1])

y=tf.placeholder(tf.float32,[None,1])

w1=tf.Variable(tf.random_normal([1,10]))

b1=tf.Variable(tf.zeros([1,10]))

wx_plus_b1=tf.matmul(x,w1)+b1

l1=tf.nn.tanh(wx_plus_b1)

w2=tf.Variable(tf.random_normal([10,1]))

b2=tf.Variable(tf.zeros([1,1]))

wx_plus_b2=tf.matmul(l1,w2)+b2

predict=tf.nn.tanh(wx_plus_b2)

#损失函数选用SME

loss=tf.reduce_mean(tf.square(y-predict))

#优化函数选取梯度下降法

train=tf.train.GradientDescentOptimizer(0.1).minimize(loss)

with tf.Session() as sess:

predict_y = None

sess.run(tf.global_variables_initializer())

for i in range(2000):

sess.run(train,feed_dict={x:x_data,y:y_data})

#训练完成后,通过模型得到预测的y值

predict_y=sess.run(predict,feed_dict={x:x_data})

plt.figure()

plt.scatter(x_data,y_data)

plt.plot(x_data,predict_y,'r',lw=5)

plt.show()

x的取值在[-1,1]之间进行回归吧是没有问题的,但扩大x的范围后,y值值域异常

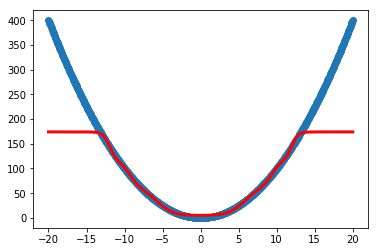

如下所示,现修改部分代码:

x_data = np.linspace(-10,10, 1000)[:,np.newaxis]

# wx_plus_b2=tf.matmul(l1,w2)+b2

# predict=tf.nn.tanh(wx_plus_b2)

# tanh的值域为[-1,1],如果第二层网络采用tanh、sigmoid或者relu等激活函数,

# 值域会预期不同,故把上面两个语句改为一个语句(或采用线性激活函数)

predict=tf.matmul(l1,w2)+b2回归的函数值域就出现问题,结果如下图所示:

请问该如何解决x的取值较大时,回归的y值值域异常问题?

(设计合适的激活函数?或者还是其他方法?)